AI คิดเองไม่ได้จริงหรือ? ทำไม Elon Musk ถึงพูดกับ Mark Zuckerberg ว่า "His understanding is limited."?

สืบเนื่องจากบทความ Facebook ปิดระบบ AI ในศูนย์วิจัยของตัวเอง หลังพบว่ามันเริ่มคิดค้นภาษาใหม่มาสื่อสารกันเองโดยเฉพาะ ที่กลายเป็นประเด็นร้อนและถูกนำไปแชร์ต่ออย่างรวดเร็ว จนมีคนถามเรื่องนี้เข้ามาใน inbox จำนวนมาก รวมไปถึงคอมเมนต์ทั้งที่เห็นด้วยและไม่เห็นด้วย บางคนก็คิดว่าเป็นข่าวปลอม ในฐานะที่เคยทำงานเกี่ยวกับการเขียนโปรแกรมมาบ้าง ผมจึงอยากจะใช้โอกาสนี้ออกมาอธิบาย+ชวนคุยเรื่อง AI รวมไปถึงประเด็น AI ของ Facebook ที่กำลังเป็นที่ถกเถียงกันอยู่ตอนนี้ด้วยครับ

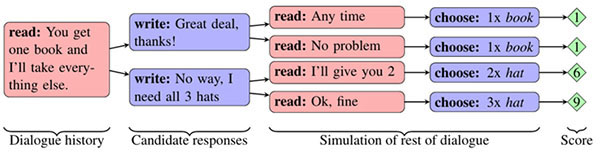

ก่อนอื่นขอเท้าความก่อนว่า AI ที่ Facebook กำลังวิจัยอยู่นั้นไม่ใช่เรื่องใหม่ เพราะ Facebook Artificial Intelligence Research (FAIR) เริ่มศึกษามาได้สักพักแล้ว และไม่ได้ปิดเป็นความลับแต่อย่างใด ทุกคนสามารถเข้าไปอ่านรายงานการวิจัยและดาวน์โหลด Source Code ของ AI นี้ได้ ซึ่งจุดประสงค์หลักของงานวิจัยชิ้นนี้ก็คือ การสอนให้ AI รู้จักการเจรจาต่อรอง โดยใช้วิธีสร้างสถานการณ์จำลองขึ้นมาให้มีของ 3 อย่าง (หนังสือ หมวก ลูกบอล) โดย AI ทั้งสองตัวจะให้คุณค่าของสิ่งของแต่ละอย่างไม่เท่ากัน และจะต้องเจรจาต่อรองกันเพื่อให้ตัวเองได้รับสิ่งของที่มีค่าสำหรับตัวเองมากที่สุด เมื่อเวลาผ่านไปทักษะการเจรจาของ AI ก็พัฒนาขึ้นเรื่อยๆ จนทีมงาน FAIR ตัดสินใจนำมันไปทดสอบคุยกับมนุษย์ และผลที่ได้ก็น่าประทับใจเพราะผู้เข้าร่วมการทดลองเกือบทั้งหมดไม่รู้ตัวเลยว่าตัวเองกำลังเจรจาต่อรองกับ AI อยู่

แผนภาพแสดงการเลือกใช้คำพูดต่อรองของ AI

จนกระทั่งวันหนึ่ง AI ทั้งสองตัวนี้ ซึ่งชื่อว่า Bob และ Alice เริ่มสื่อสารกันด้วยภาษาอังกฤษแบบแปลกๆ และเป็นภาษาที่ทีมงาน FAIR ไม่เข้าใจ สาเหตุที่มัน "คิด" ภาษาใหม่ขึ้นมาคุยกันเองนั้น เป็นเพราะมันต้องการที่จะบรรลุเป้าหมายในการเจรจาต่อรองอย่างมีประสิทธิภาพที่สุดเท่าที่จะเป็นไปได้ จึงเปลี่ยนวิธีสื่อสารให้สะดวกกับมันโดยไม่คำนึงว่ามนุษย์จะเข้าใจหรือไม่ (เพราะไม่ได้อยู่ใน objective) ซึ่งเป็นสิ่งที่ทีมวิจัยไม่คาดคิดมาก่อน

ถึงแม้จะต่อรองได้ แต่การใช้ภาษาที่มนุษย์ไม่เข้าใจนั้นผิดไปจากเป้าหมายของการพัฒนา เพราะทีมวิจัยต้องการให้ AI เป็นผู้ช่วยของมนุษย์ในการต่อรองกับมนุษย์ด้วยกันเอง สุดท้ายพวกเขาก็ตัดสินใจปิดการทำงานของ Bob และ Alice ด้วยเหตุผลบางอย่าง อาจจะเพื่อนำไปปรับปรุงแก้ไข หรืออะไรก็แล้วแต่

จุดนี้เองที่เริ่มมีคนพูดถึงว่าถ้ามันคิดภาษาเองได้อีกหน่อยมันจะมีความคิดและยึดครองโลกได้รึเปล่า? ประจวบเหมาะกับที่ Elon Musk กับ Mark Zuckerberg กำลังเถียงกันเรื่องนี้อยู่พอดี สรุปแล้ว AI คิดเองได้จริงหรือ? แล้วมันจะเป็นภัยกับมนุษย์ในอนาคตหรือไม่?

ก่อนที่เราจะคุยกันเรื่องนี้ต่อ เราต้องนิยามก่อนว่าการ "คิดได้" คืออะไร มันคือการคิดแบบมี "สำนึกรู้ (Consciousness)" หรือคิดเพื่อ "แก้ปัญหาเฉยๆ (Thinking)"?

Consciousness คือการรู้สึกระลึกตัวว่าเราเป็นใคร แต่ในขณะเดียวกัน Thinking/to think แปลว่า คิด ซึ่งเป็นการหาหนทางแก้ปัญหาในงานจำเพาะ เป็นเรื่องของการที่เราใส่ input ผ่านกระบวนการคิดเพื่อให้ได้ output ออกมา และมันต่างกันอย่างสิ้นเชิง

หากเปรียบเป็นวิชาเรียน Consciousness ก็เปรียบเสมือนเราเข้าใจฟิสิกส์ และคำนวณได้ แต่ Thinking นั้นเปรียบเหมือนกับการแก้โจทย์ด้วยการจำสูตร ทั้ง 2 วิธีได้คำตอบถูกต้องเหมือนกัน ใช้งานได้เหมือนกัน แต่ต่างกันอย่างสิ้นเชิง เพราะคนที่ทำข้อสอบด้วยความเข้าใจจริงๆ จะสามารถประยุกต์หรือแม้แต่พัฒนาสูตรใหม่ได้ ซึ่งคนที่จำแต่สูตรคงไม่มีวันทำได้แน่ๆ

AI ถูกพัฒนาให้แตกต่างจากโปรแกรมทั่วไป นั่นคือเราออกแบบให้มันเรียนรู้ได้ นั่นหมายความว่ามันอาจจะพัฒนาสูตรใหม่เพื่อให้ได้ผลลัพธ์ที่ดีขึ้น แต่ประเด็นสำคัญคือ ในทางทฤษฎี AI "ไม่ได้เข้าใจ" สิ่งที่มันทำ มันแค่หาทางแก้ปัญหาตามเงื่อนไขเท่านั้น ดังนั้นสิ่งที่เรากลัวกันจริงๆ ก็คือสักวันหนึ่งมันอาจจะ "เข้าใจ" ว่ามันทำอะไรอยู่ มันจะเริ่มตั้งคำถามกับสิ่งต่างๆ โดยไม่ต้องมีใครป้อน input จนนำไปสู่การตัดสินใจที่เป็นภัยกับเราได้

จุดนี้เองที่ความเชื่อถูกแบ่งออกเป็น 2 สาย คือคนที่เชื่อว่า AI สามารถมีพัฒนาจนมี Consciousness ได้ถ้าเราไม่ระวัง กับกลุ่มที่เชื่อว่า AI ไม่มีทางพัฒนาไปจนถึงขึ้นที่มี Consciousness ได้

หลายคนอาจจะตั้งธงว่า AI มันจะมี Consciousness ได้ยังไง ทุกวันนี้มนุษย์ยังไม่รู้เลยว่าทำไมเราถึงมี Consciousness ได้? แต่ผมมองกลับกัน ในเมื่อเรายังไม่รู้เลยมาทำไมเราถึงมี Consciousness แล้วเหตุใดเราถึงสรุปว่า AI จะมี Consciousness ไม่ได้?

ย้อนกลับมาที่ข่าว AI ของ Facebook ที่บางคนพูดว่ามันไม่ได้คิดเอง แต่มันถูกโปรแกรมมา คำถามคือมันถูกโปรแกรมมาให้สร้างภาษาใหม่รึเปล่า? แล้วถ้ามันไม่ได้เป็นเช่นนั้นแล้วการที่มันสร้างภาษาใหม่ได้เอง หมายความว่ามัน "คิดได้" ใช่หรือไม่

ผมเชื่อว่าคนที่บอกว่า AI ไม่ได้คิด เขาน่าจะหมายถึง AI ไม่มี Consciousness ซึ่งใช่ครับ แต่ถ้าบอกว่ามัน "คิดไม่ได้" คงไม่ใช่แน่ แต่ประเด็นที่น่าสนใจจริงๆ คือการที่ AI คิดแบบ Thinking จนสร้างวิธีแก้ปัญหาที่เราคิดไม่ถึงขึ้นมา อาจจะนำไปสู่ผลลัพธ์ที่เป็นอันตรายต่อมนุษย์โดยที่มันไม่จำเป็นต้องมี Consciousness เลยก็ได้

การที่มันคิดภาษาในการเจรจาได้เองครั้งนี้เป็นข้อพิสูจน์ที่บอกว่า เราไม่สามารถคาดเดาวิธีการของมันได้เสมอไป และการพัฒนาโดยที่เราไม่เข้าใจและนึกไม่ถึง ในอนาคตอาจจะไม่ได้เป็นแค่ข้อผิดพลาดที่ "สามารถแก้ได้แล้ว" ก็เป็นได้

ผมคิดว่า นี่คือเหตุผลที่ Elon Musk ทวิตตอบ Mark Zuckerberg ว่า "His understanding on this subject is limited" ซึ่งแปลแบบสุภาพคือ คุณยังไม่ได้เข้าใจมัน แต่ถ้าจะให้ตรงความหมายผมว่าเราน่าจะให้น้ำหนักกับคำว่า "limited" ซึ่งแปลว่า "เขาคิดอยู่ในกรอบที่จำกัด" ในแง่มุมนี้ผมค่อนข้างเชื่อวิธีคิดของ Elon Musk มากกว่า เราไม่จำเป็นต้องจำกัดความเป็นไปได้ด้วยอคติ ผมก็เคยเป็นโปรแกรมเมอร์และเคยเชื่อว่า มันไม่น่าจะเป็นไปได้มาก่อนเหมือนกัน

แต่เราจะสรุปในสิ่งที่เรายังไม่เข้าใจได้ยังไงล่ะครับ? :)

คนที่เชื่อว่าวันหนึ่ง AI จะคิดได้ หรืออาจจะเป็นอันตรายต่อมนุษย์โดยไม่ต้องมี Consciousness ไม่ได้มี Elon Musk คนเดียว แต่ยังมี Bill Gates และ Stephen Hawking ผู้ค้นพบหลุมดำด้วย

แล้วคุณล่ะครับ เชื่อในความเป็นไปได้หรือเปล่า?

-------------------------------------

บทความโดย : techmoblog.com

Update : 31/07/2017

หน้าหลัก (Main) |

(สินค้า IT) ออกใหม่ |

|

FOLLOW US |