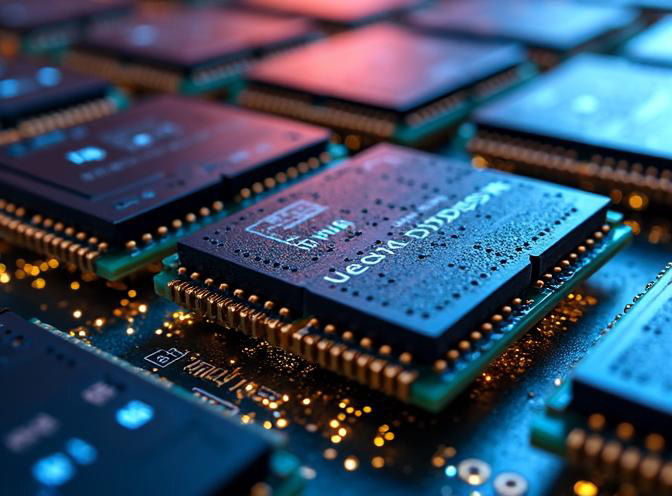

ราคา DRAM และ NAND พุ่งแรงต้นปี 2026 เหตุเพราะความต้องการจากตลาด AI คาดแพงยาวถึงปี 2028

เมื่อต้นเดือนมกราคมที่ผ่านมา TrendForce ได้ออกมาเตือนว่า ราคา DRAM แบบ Contract Price ซึ่งถูกใช้งานตั้งแต่สมาร์ตโฟนไปจนถึงเซิร์ฟเวอร์ อาจปรับขึ้นถึง 55-60% เมื่อเทียบกับไตรมาสก่อน (QoQ) ในไตรมาสแรกของปี 2026 ขณะที่ NAND Flash ซึ่งใช้ในอุปกรณ์จัดเก็บข้อมูลแบบ SSD มีแนวโน้มเพิ่มขึ้น 33-38%

อย่างไรก็ตาม ล่าสุด TrendForce ได้ออกมาเผยว่า ราคา DRAM แบบ Contract Price อาจพุ่งสูงถึง 90-95% (QoQ) ส่วนราคา NAND คาดว่าจะเพิ่มขึ้นราว 55-60% ภายในไตรมาสเดียวกัน

แม้ความต้องการจากตลาด AI จะเป็นสาเหตุหลัก แต่ TrendForce ยังชี้ว่า ยอดส่งมอบพีซีในไตรมาส 4 ปี 2025 ที่สูงกว่าคาด ก็ยิ่งซ้ำเติมปัญหาการขาดแคลนหน่วยความจำให้รุนแรงขึ้นไปอีก

ก่อนหน้านี้ OEM รายใหญ่อย่าง Dell และ HP มักสั่งซื้อหน่วยความจำล่วงหน้าประมาณ 1 ปี ทำให้ราคาคอมพิวเตอร์สำเร็จรูปยังคงทรงตัว แม้ราคาแรมแบบแยกจะพุ่งขึ้นหลายเท่าก็ตาม อย่างไรก็ตาม เมื่อสต๊อกเริ่มลดลง และ OEM ต้องกลับมาสั่งซื้อใหม่ ก็มีแนวโน้มว่าราคาคอมพิวเตอร์และโน้ตบุ๊กจะปรับสูงขึ้นในระยะถัดไป

TrendForce คาดว่า ราคา DRAM สำหรับพีซี จะเพิ่มขึ้นเกือบเท่าตัวเมื่อเทียบกับช่วงปลายปีที่ผ่านมา และหน่วยความจำ LPDDR ที่ใช้ในโน้ตบุ๊กแบบบัดกรีแรม รวมถึงสมาร์ตโฟน ก็จะปรับขึ้นแรงไม่แพ้กัน โดย LPDDR4x และ LPDDR5x อาจเพิ่มขึ้นราว 90% (QoQ) ซึ่งถือเป็นการปรับขึ้นที่รุนแรงที่สุดเท่าที่เคยมีมา

แม้ LPDDR จะถูกใช้งานหลักในโน้ตบุ๊ก แต่ระบบแร็กประสิทธิภาพสูงของ NVIDIA หนึ่งชุด มีการติดตั้ง LPDDR5x มากถึง 54TB ต่อระบบ ซึ่งยิ่งเพิ่มแรงกดดันต่อซัพพลายหน่วยความจำในตลาด

ด้าน NAND Flash ก็มีแนวโน้มปรับราคาสูงขึ้นอย่างมากเช่นกัน เนื่องจาก Hyperscaler และ CSP เร่งติดตั้ง SSD เพื่อรองรับงาน AI Inference อย่างเต็มที่

TrendForce ระบุว่า ความต้องการอุปกรณ์จัดเก็บข้อมูลประสิทธิภาพสูงเพิ่มขึ้นเกินกว่าที่คาดไว้มาก จากการเติบโตของ AI ที่เน้นงาน Inference เป็นหลัก และตั้งแต่ช่วงปลายปี 2025 ผู้ให้บริการ Cloud รายใหญ่ในอเมริกาเหนือได้เร่งสั่งซื้อ SSD สำหรับองค์กรอย่างต่อเนื่อง เมื่อโครงสร้างพื้นฐานของ AI เปลี่ยนจากการฝึกโมเดล (Training) ไปสู่การใช้งานจริง (Inference) มากขึ้น ก็ยิ่งต้องใช้ทั้งหน่วยความจำและสตอเรจในปริมาณมหาศาล

ในกระบวนการ Inference ของ Large Language Model (LLM) จะมีการเก็บสถานะของโมเดลไว้ในสิ่งที่เรียกว่า Key-Value Cache หรือ KV Cache ซึ่งเปรียบเสมือนความจำระยะสั้นของโมเดล โดยระหว่างใช้งาน KV Cache จะถูกเก็บไว้ใน HBM แต่เมื่อไม่มีการใช้งาน ข้อมูลเหล่านี้จะถูกย้ายไปยังหน่วยความจำระบบ และบางส่วนถูกจัดเก็บลงในสตอเรจ

แม้แนวทางนี้จะช่วยลดภาระการประมวลผล และทำให้การใช้งาน AI ตอบสนองได้รวดเร็วขึ้น แต่ข้อเสียคือ ต้องใช้หน่วยความจำจำนวนมหาศาลในการจัดเก็บ KV Cache เหล่านี้

TrendForce ย้ำว่า แม้ราคา DRAM อาจแตะจุดสูงสุดภายในปีนี้ แต่จะต้องใช้เวลาหลายปีกว่าราคาจะกลับสู่ภาวะปกติ และคาดว่าราคา RAM จะยังคงอยู่ในระดับสูงต่อเนื่องไปจนถึงปี 2028

-------------------------------------

ที่มา : theregister.com

นำเสนอบทความโดย : techmoblog.com

Update : 05/02/2026

หน้าหลัก (Main) |

(สินค้า IT) ออกใหม่ |

|

FOLLOW US |