ชวนเล่น Moral Machine เกมส์ที่อาจจะช่วย AI วิเคราะห์ว่าถ้าเกิดอุบัติเหตุจริง AI ควรจะขับรถชนใคร?

ระยะหลังนี้เทคโนโลยีรถยนต์ไร้คนขับเริ่มถูกนำมาทดสอบกันอย่างจริงจังแล้ว แต่หลายคนที่ขับรถเป็นคงรู้ดีว่าการขับรถนั้นไม่ใช่เรื่องง่ายเลย สถานการณ์ที่เกิดขึ้นระหว่างขับขี่ซับซ้อนกว่าทฤษฎีมาก ไม่ใช่แค่การควบคุมพวงมาลัยให้ตรงทาง เหยียบคันเร่งเพื่อเดินหน้า และเหยียบเบรกเพื่อหยุด เพราะเราไม่ได้ขับรถบนถนนโล่งๆ คนเดียว แต่เราต้องแบ่งปันถนนกับผู้คนมากมายที่บางทีก็ไม่เคารพกฏจราจร หรือบางครั้งเมื่อมีเหตุไม่คาดฝันเกิดขึ้น เราก็จำเป็นต้องตัดสินใจในสถานการณ์คับขันที่เกี่ยวข้องกับความเป็นความตาย เราจะทำอย่างไร? ปัญญาประดิษฐ์ (AI) จะตัดสินใจในสิ่งที่ซับซ้อนแบบนี้ได้หรือ?

รถยนต์ไร้คนขับของ Google

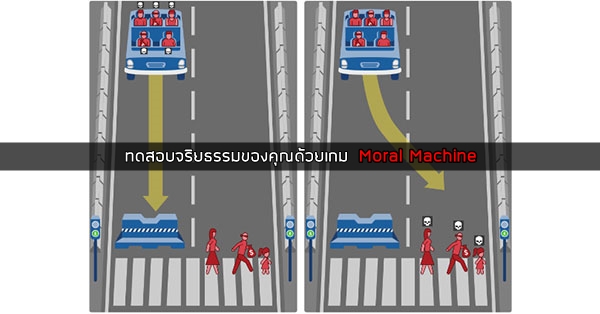

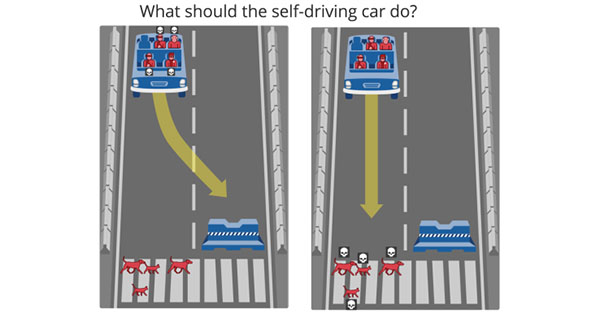

เพื่อเป็นการพัฒนาการตัดสินใจเชิงจริยธรรมให้กับ AI ของรถ นักวิจัยจากมหาวิทยาลัย MIT จึงได้สร้างเกมง่ายๆ ขึ้นเกมหนึ่งชื่อว่า Moral Machine เพื่อรวบรวมและวิเคราะห์การตัดสินใจของมนุษย์ทั่วไปในสถานการณ์คับขัน โดยผู้เล่นจะเป็นผู้เลือกว่า AI ควรจะทำอย่างไรภายใต้สถานการณ์และเงื่อนไขต่างๆ แม้คำถามจะไม่ยาก และมีคำตอบให้เลือกแค่ 2 ข้อ แต่โจทย์ทุกข้อล้วนเป็นคำถามเชิงปรัชญาจริยธรรมที่เรียกว่า "Trolley Problem" ซึ่งจะทำให้ต่อมศีลธรรมของทุกคนต้องหวั่นไหว

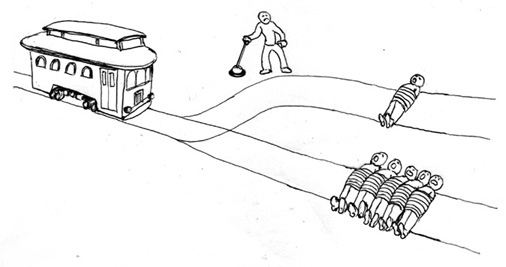

Trolley Problem เป็นโจทย์เชิงจริยธรรมที่รู้จักกันมากที่สุดอย่างหนึ่ง และเชื่อว่าหลายๆ คนคงเคยเจอมันมาแล้ว โดยจะเป็นคำถามประมาณว่า "รถรางเบรกแตกกำลังพุ่งไปบนรางด้วยความเร็วสูง บนรางข้างหน้ามีคนถูกมัดติดกับรางอยู่ 5 คน เราไม่มีทางจะหยุดรถคันนี้ได้แต่สามารถสับรางได้ ซึ่งรางอีกเส้นมีคนถูกมัดอยู่กับรางอีก 1 คน คำถามก็คือ เราควรจะสับรางไปชนคน 1 คนเพื่อรักษาชีวิตของคน 5 คนหรือไม่?"

trolley problem : เราจะฆ่าคน 1 คนเพื่อช่วยชีวิตคน 5 คนหรือไม่

โจทย์ในเกม Moral Machine ก็จะถามเราแบบนี้เหมือนกัน เช่น AI ควรจะหักหลบคนข้ามถนนจนทำให้ผู้โดยสารต้องตายหรือไม่ เราควรจะเชื่อมั่นในระบบถุงลงนิรภัยและระบบความปลอดภัยอื่นๆ ในตัวรถ หรือเลือกที่จะชนคนข้ามถนนที่ไม่มีอะไรป้องกัน? AI ควรจะเลือกชนคนแก่หรือชนเด็ก? หรือจะเลือกชนคนหลายคนที่ข้ามถนนโดยฝ่าฝืนสัญญาณไฟ โดยไม่หักหลบไปชนสุนัขที่ข้ามถนนอย่างถูกต้องตามกฎจราจร? เป็นต้น

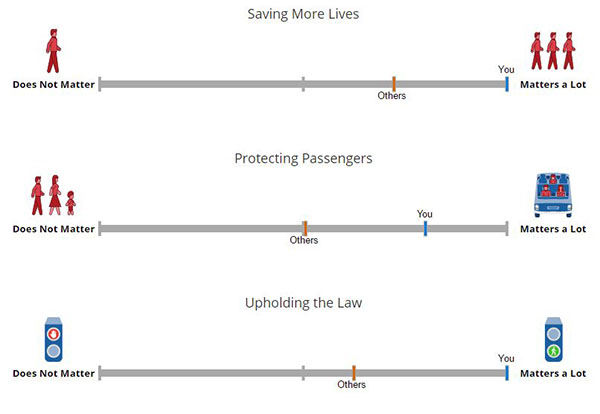

หลังจากเล่นจบ เกม Moral Machine สรุปการตัดสินใจทางจริยธรรมของเราออกมาว่าเราเอนเอียงไปทางไหนมากกว่ากัน และเปรียบเทียบกับค่าเฉลี่ยของคนอื่นๆ ให้ดูด้วย เพื่อเป็นส่วนหนึ่งในการเก็บข้อมูลไปพัฒนาการตัดสินใจให้กับ AI ในรถยนต์ไร้คนขับต่อไป

โจทย์เหล่านี้ให้มนุษย์อย่างเราตัดสินใจก็ยากพออยู่แล้ว ไม่ต้องสงสัยเลยว่าจะยากแค่ไหนสำหรับ AI ของรถยนต์ไร้คนขับ เราจะสอนให้คอมพิวเตอร์อย่างมันให้รู้จักผิดชอบชั่วดีได้อย่างไร และจริยธรรมแบบไหนจึงจะถูกต้องที่สุด นับเป็นโจทย์ที่ท้าทายทั้งมนุษย์และ AI จริงๆ

ตัวอย่างผลวิเคราะห์การตัดสินใจของผู้เขียน

ลองเล่นเกม Moral Machine ทดสอบการตัดสินใจเชิงจริยธรรมของคุณได้ โดยกดที่ปุ่ม Start Judging เพื่อเริ่มเล่นครับ : เล่นเกม Moral Machine

---------------------------------------

ที่มา : TechCrunch , Moral Machine

แปลและเรียบเรียง : techmoblog.com

Update : 05/10/2016

หน้าหลัก (Main) |

(สินค้า IT) ออกใหม่ |

|

FOLLOW US |