Apple เปิดตัวฟีเจอร์กรองเนื้อหาที่ไม่เหมาะสมสำหรับเด็ก พร้อมปล่อยอัปเดตลง iOS 15, iPadOS 15, watchOS 8 และ macOS Monterey ในปลายปีนี้

ล่าสุด Apple ได้ประกาศเปิดตัวฟีเจอร์ใหม่ ซึ่งจะเป็นฟีเจอร์กรองเนื้อหาที่ไม่เหมาะสมสำหรับเด็ก ไม่ว่าจะเป็นข้อความหรือรูปภาพที่ถูกส่งมายัง Messages, iCloud Photo รวมถึงข้อมูลที่ได้จาก Siri และการค้นหาต่าง ๆ ซึ่งฟีเจอร์ดังกล่าวจะมีทั้งบน iPhone, iPad และ Mac

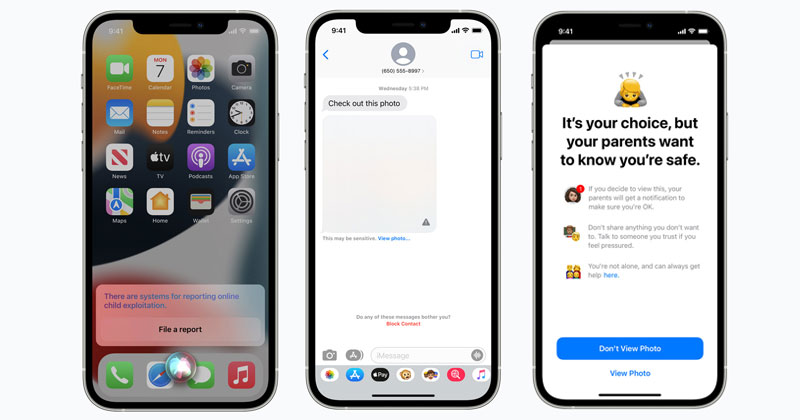

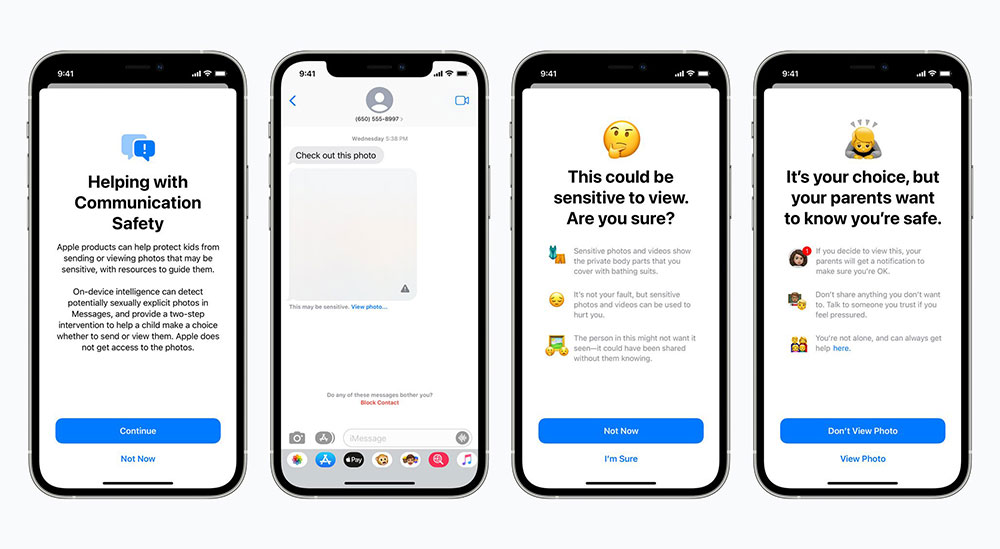

สำหรับแอปฯ Messages นั้น ทาง Apple อธิบายไว้ว่า เมื่อใดก็ตามที่เด็กได้รับรูปภาพโป๊เปลือย รูปดังกล่าวจะถูกเบลอและมีแจ้งเตือนปรากฎขึ้นมา ถ้าหากเด็กกดดูรูปภาพนั้น ก็จะมีแจ้งเตือนปรากฎขึ้นมาอีกครั้งว่า ภาพดังกล่าวอาจจะไม่เหมาะสม

ในทำนองเดียวกัน ถ้าหากเด็กพยายามที่จะส่งภาพโป๊เปลือย ก็จะมีข้อความแจ้งเตือนเด้งขึ้นมาก่อนที่ภาพดังกล่าวจะถูกส่งออกไป รวมถึงมีการแจ้งเตือนไปยังผู้ปกครองด้วยเช่นกัน

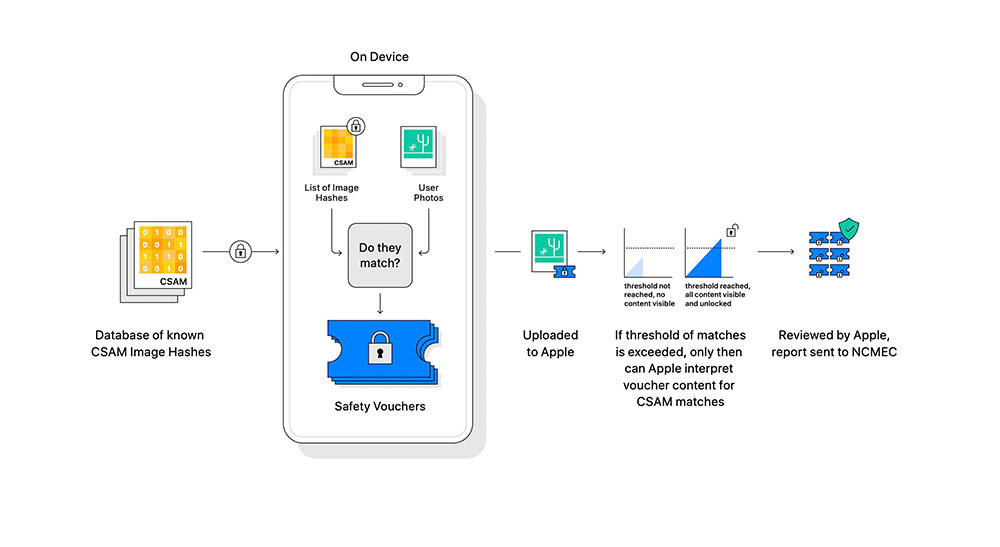

นอกจากเรื่องของภาพโป๊เปลือยแล้ว ทาง Apple ยังเน้นในเรื่องของการล่วงละเมิดทางเพศในเด็ก (Child Sexual Abuse Material : CSAM) ซึ่งจะมีการตรวจจับภาพที่เป็น CSAM ที่ถูกเก็บไว้ใน iCloud Photos และรายงานไปยังศูนย์เพื่อเด็กหายและถูกฉวยผลประโยชน์แห่งชาติ (National Center for Missing and Exploited Children)

นอกจากนี้ Apple ยังมีข้อมูลให้ความช่วยเหลือต่าง ๆ สำหรับผู้ปกครองและเด็กผ่านทาง Siri และการค้นหา ซึ่งจะมีการแนะนำหากอยู่ในสถานการณ์ที่ไม่ปลอดภัย ยกตัวอย่างเช่น สอบถาม Siri ว่า จะรายงานภาพ CSAM ได้ที่ไหน ก็จะมีการแนะนำลิงก์รายงานให้ เป็นต้น

ทั้งนี้ ฟีเจอร์ดังกล่าวจะรองรับกับบัญชี iCloud แบบ Family เท่านั้น ซึ่งจะปล่อยอัปเดตอย่างเป็นทางการบน iOS 15, iPadOS 15, watchOS 8 และ macOS Monterey ในปลายปีนี้

-------------------------------------

ที่มา : 9to5mac.com , apple.com

เรียบเรียง : techmoblog.com

Update : 06/08/2021

หน้าหลัก (Main) |

(สินค้า IT) ออกใหม่ |

|

FOLLOW US |